4月25日,DeepSeek-V4模型预览版正式上线并同步开源。该模型拥有百万字超长上下文,在Agent能力、世界知识和推理性能上均实现国内与开源领域的领先,分为Pro和Flash两个版本。即日起用户可登录官网或官方App体验,API服务也已同步更新。

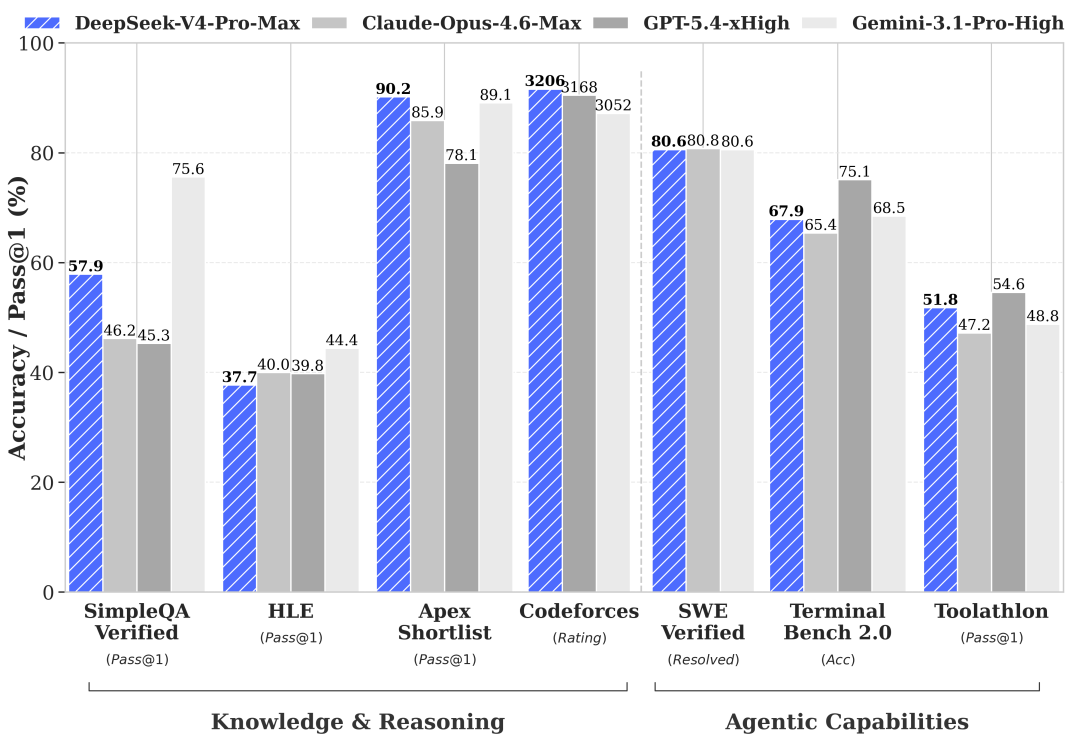

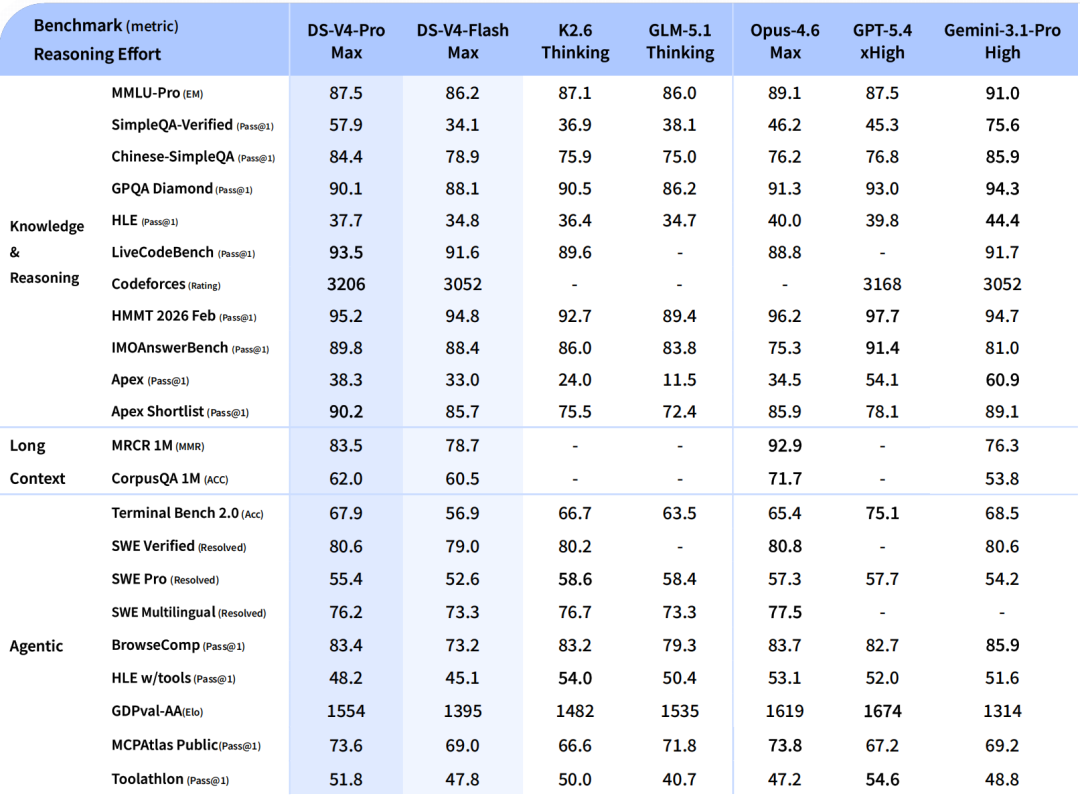

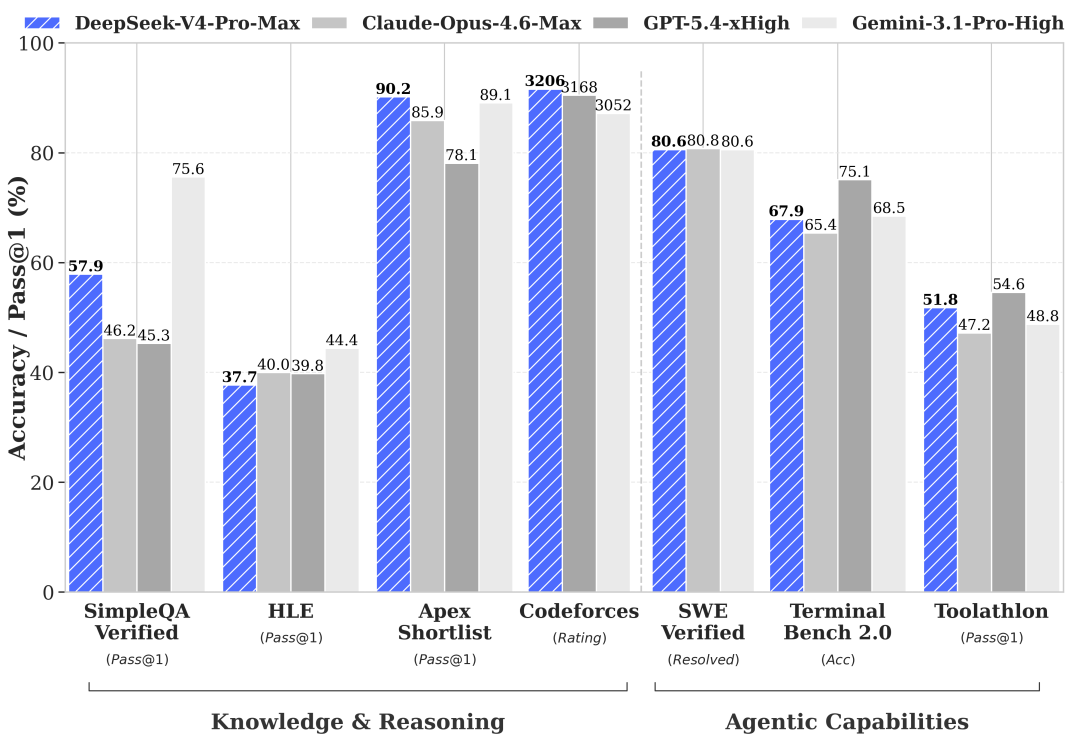

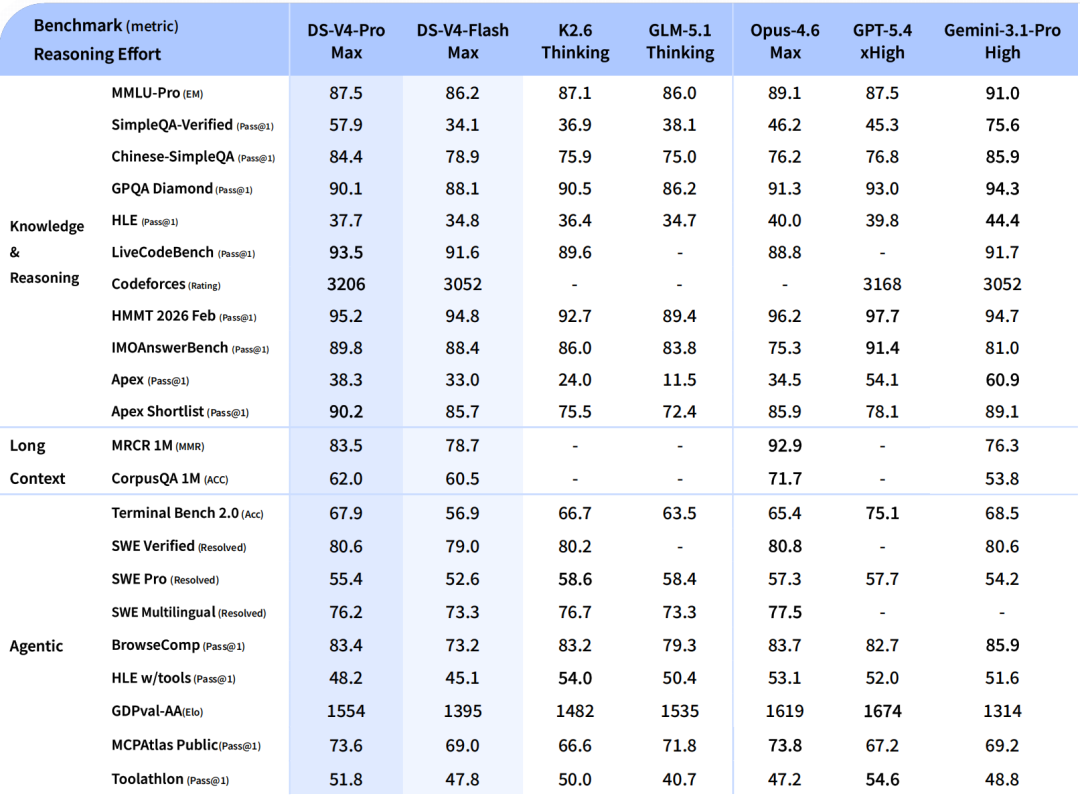

DeepSeek-V4-Pro在Agentic Coding评测中达到当前开源模型最佳水平,世界知识测评大幅领先其他开源模型,数学、STEM、竞赛型代码测评中超越所有已公开评测的开源模型。DeepSeek-V4-Flash在世界知识储备方面稍逊,但展现出接近的推理能力,能够提供更加快捷、经济的API服务。DeepSeek-V4开创了一种全新的注意力机制,在token维度进行压缩,结合DSA稀疏注意力,实现了全球领先的长上下文能力,1M上下文将成为DeepSeek所有官方服务的标配。

英伟达宣布其NVIDIA Blackwell平台已成功适配DeepSeek-V4-Pro和DeepSeek-V4-Flash两款模型,开发者现可通过NVIDIA NIM微服务进行下载部署,或利用SGLang与vLLM框架实现定制化推理。摩尔线程与智源FlagOS合作,成功为旗舰级AI训推一体全功能GPU MTTS5000完成了DeepSeek-V4-Flash模型的Day-0适配。为充分发挥MTTS5000的FP8优势,FlagOS团队对DeepSeek-V4模型进行了FP8量化。双方技术团队在FP8算子与SparseAttention算子上进行了系统级分析,并在编译优化与自动调优两大方向取得了重大突破。摩尔线程已多次实现国产大模型的Day-0即时适配,包括MiniMaxM2.7、智谱GLM-5等。

寒武纪宣布已基于vLLM推理框架完成对DeepSeek-V4-flash和DeepSeek-V4-pro的Day 0适配,模型发布当日即可实现稳定运行。华为官方随后宣布,通过双方芯模技术紧密协同,实现昇腾超节点全系列产品支持DeepSeek V4系列模型。昇腾950超节点可实现TPOT约20ms时单卡Decode吞吐4700TPS,昇腾A3 64卡超节点结合大EP模式部署,DeepSeek V4-Flash模型可实现2000+TPS的单卡Decode吞吐。

来源:一电快讯

返回第一电动网首页 >

以上内容由AI创作,如有问题请联系admin#d1ev.com(#替换成@)沟通,AI创作内容并不代表第一电动网(www.d1ev.com)立场。

文中图片源自互联网或AI创作,如有侵权请联系邮件删除。