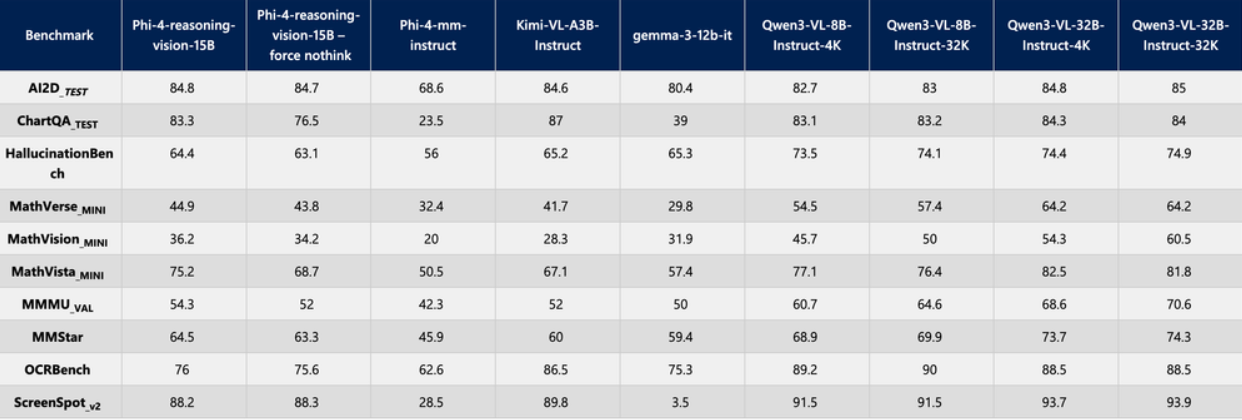

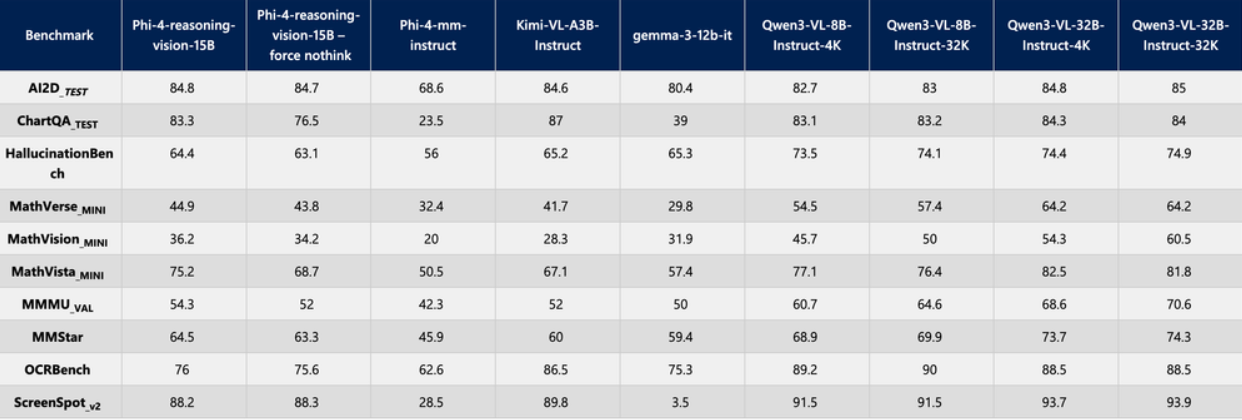

3月5日,微软官方开发者社区博客宣布,微软发布了一款名为Phi-4-Reasoning-Vision-15B的视觉推理模型。这款模型是Phi-4系列中首个结合高分辨率视觉感知与选择性、任务感知推理的小语言模型(SLM),能够实现“看得清楚”和“想得深入”。与传统视觉模型仅执行被动感知不同,Phi-4-Reasoning-Vision-15B能够执行结构化、多步骤的推理,理解图像中的视觉结构,将其与文本上下文连接,并得出可操作的结论。

Phi-4-Reasoning-Vision-15B的关键设计特征是其混合推理行为,可以根据提示在“推理模式”和“非推理模式”之间切换。在需要深度推理时,如数学问题、逻辑分析,启用多步推理链;而在快速感知足够时,如OCR、元素定位,直接输出以降低延迟。该模型最重要的应用领域之一是搭配计算机智能体使用,能够接收屏幕截图和自然语言指令,输出目标UI元素的标准化边界框坐标,供其他智能体模型执行点击、滚动等交互操作。

来源:一电快讯

返回第一电动网首页 >

以上内容由AI创作,如有问题请联系admin#d1ev.com(#替换成@)沟通,AI创作内容并不代表第一电动网(www.d1ev.com)立场。

文中图片源自互联网或AI创作,如有侵权请联系邮件删除。